Атаки на биометрические системы

Григорий Маршалко, 23/01/19

Задумывались ли вы когда-нибудь о том, что отличает вас от остальных людей? Наверное, у каждого в жизни бывает такой момент, когда хочется убедиться в том, что ты один во всем мире и второго такого нет. Приятно осознавать, что только у тебя такое лицо, только у тебя такие глаза, только у тебя такая походка, такой голос и, наконец, таких отпечатков пальцев, как у тебя, больше ни у кого нет. Все эти уникальные для каждого человека характеристики являются биометрическими данными, которые можно описать математически и использовать в качестве входных данных алгоритмов машинного обучения, с тем чтобы автоматизировать процесс распознавания.

Авторы:

Светлана Круглова, ВМиК МГУ им. М.В. Ломоносова

Лидия Никифорова, ВМиК МГУ им. М.В. Ломоносова

Григорий Маршалко, эксперт ТК 26, эксперт ISO/IEC JTC1/SC 27

Если перед вами стоит задача доказать, что вы именно тот, за кого себя выдаете, если вы хотите, чтобы доступ к какой-либо информации или системе управления имели только вы, то для этой цели представляется удобным использовать биометрические технологии. В связи с этим в последние годы происходит их внедрение в информационно-телекоммуникационные системы в качестве средства идентификации (в частности, удаленной), а зачастую и аутентификации пользователей. Если пользователь является добропорядочным человеком, то он заинтересован в корректном результате работы таких систем. Если же нет, то в зависимости от преследуемых целей злоумышленник пытается либо использовать случайный, либо целенаправленно инициированный сбой работы системы [1]. В этой связи возникает вопрос: являются ли биометрические системы надежными и безопасными?

Несмотря на значительное повышение точности, существующие методы распознавания изображений являются вероятностными и допускают появление ошибок распознавания, вызванных различными факторами: внешним освещением, характеристиками устройств регистрации (оцифровки) биометрических признаков.

С другой стороны, злоумышленник может пытаться целенаправленно вносить ошибки в процесс распознавания, пытаясь заставить систему некорректно распознать обрабатываемый образ [2].

В большинстве своем алгоритмы биометрических систем состоят из последовательности элементарных преобразований входных данных, при этом большинство таких преобразований являются очень чувствительными к малейшим изменениям входных данных. Использование этого свойства позволяет нарушителю в ряде случаев влиять на результат распознавания биометрической системы с помощью модификаций биометрических образов и является важной проблемой в обеспечении безопасности системы.

Атаки

Атаки на биометрические образы бывают двух типов:

- нецелевая атака (общий тип атаки, когда основной целью является неверный результат классификации);

- целевая атака (более сложная атака, целью которой является получение определенного класса при данном входном изображении).

Самый простой и в то же время эффективный алгоритм атаки известен как быстрый метод знака градиента (FGSM – Fast Gradient Sign Method) [3], предложенный Гудфеллоу. Он может использоваться при обоих типах атак. Основная идея этого итеративного метода состоит в том, чтобы добавлять некоторый слабый шум к изображению на каждой итерации, переходя по направлению к требуемому изображению.Такая атака, часто называемая спуфинг-атака, эффективна при статическом анализе изображения, например когда противник имеет возможность произвольно изменять входные данные (изменять каждый пиксель изображения). Это возможно, когда нарушитель имеет ограниченный доступ к системе, так как зачастую входные данные алгоритм распознавания получает, например, с камер видеонаблюдения, к которым противник не имеет прямого доступа, что делает многие спуфинг-атаки практически нереализуемыми.

Чтобы преодолеть разрыв между теоретическими результатами и реальными условиями, в последнее время создается много тестовых устройств. Одним из ярких примеров являются очки [1], разработанные с изображением на оправе, позволяющим идентифицировать владельца в качестве другого человека (рис. 1).

Рис. 1. Примеры использования оправы очков, чтобы выдать себя за другого человека

Рис. 1. Примеры использования оправы очков, чтобы выдать себя за другого человека

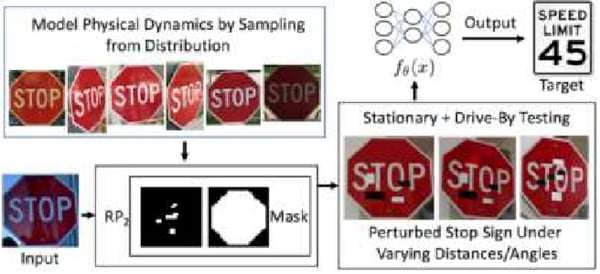

Еще одним исследованием аналогичной тематики является возможность изменения изображения дорожных знаков для обхода распознавания с помощью глубоких нейронных сетей (Deep Neural Networks) (рис. 2.) [4].

Рис. 2. Пример использования знака "Стоп", чтобы он был распознан как знак ограничения скорости

Рис. 2. Пример использования знака "Стоп", чтобы он был распознан как знак ограничения скорости

Атака заключается в использовании черных и белых наклеек с тем, чтобы нейронная сеть распознавала знак "Стоп" как знак ограничения скорости.

В марте 2018 г. китайская команда из Фуданьского университета предложила так называемый метод невидимой маски, при использовании которого нарушитель, не внося видимых изменений в свою внешность, будет идентифицироваться системами распознавания как совершенно другой человек [5]. Это достигается с помощью инфракрасного (ИК) излучения, которое не может быть замечено глазами человека, но все еще может быть зарегистрировано большинством уличных камер, устройств наблюдения и даже смартфонами. Учитывая крошечные размеры освещающих ИК-светодиодов, их можно легко встроить в кепку, спрятать в зонтике и, возможно, даже волосах или парике. Как только устройства будут включены, инфракрасные точки будут проецироваться на стратегические точки на лице злоумышленника тонко изменяя его черты лица, чтобы вызвать ошибочную классификацию в системе распознавания. Данный подход является прорывом в атаках на системы распознавания и демонстрирует, что биометрические методы идентификации нуждаются в более серьезной защите.

Следует отметить, что относительная простота критериев принятия решения, используемых в системах биометрической идентификации, предоставляет нарушителям широкий спектр возможностей построения векторов атак. Зачастую нарушитель может изменять различные параметры изображения, добиваясь некорректной классификации.

Алгоритм идентификации по лицу

Рассмотрим один из широко используемых алгоритмов идентификации людей по лицам – алгоритм Eigenfaces [6], в основе которого лежит классический метод главных компонент [7]. В данном алгоритме каждое изображение представляется в виде разложения по некоторым базовым изображениям (так называемым собственным лицам), содержащим основную информацию об исходном.

Можно предложить способ реализации атаки, который заключается в применении варианта градиентного метода для направленного изменения весов атакующего изображения в разложении по указанным базовым изображениям [8]. Как показывают исследования, вносимые при этом искажения для большинства сторонних наблюдателей оказываются незаметными.

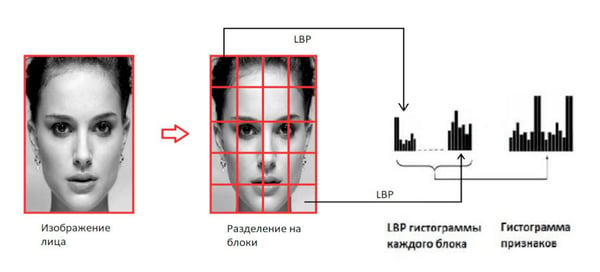

Широко зарекомендовал себя также метод распознавания, основанный на использовании локальных бинарных шаблонов (LBP), поскольку он инвариантен к изменению освещения изображаемого объекта.

Метод LBP основан на вычислении гистограмм определенного вида для участков изображения, по которым строится результирующая гистограмма всего изображения (рис. 3), она затем используется для сравнения с гистограммой эталонного изображения [9].

Рис. 3. Разбиение изображения на области и формирование гистограммы изображения

Рис. 3. Разбиение изображения на области и формирование гистограммы изображения

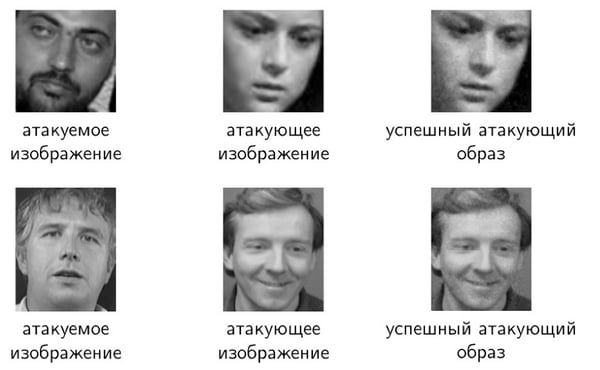

В данном случае атака может быть построена посредством изменения значений отдельных пикселей изображения, при этом для сохранения естественности для модификации используются малоинформативные части изображения, например волосы или фон [10].

Примеры успешных реализаций алгоритма представлены на рис. 4, в данном случае удалось максимально приблизить исходное изображение к атакуемому.

Рис. 4. Пример изменения изображения в зависимости от итерации

Рис. 4. Пример изменения изображения в зависимости от итерации

Таким образом, описанные атаки показывают простоту обхода алгоритмов биометрической идентификации, что не позволяет говорить о таких алгоритмах как о надежном средстве контроля доступа.

В заключение отметим, что, например, Европейский союз признает небезопасным использование одной лишь биометрической аутентификации для осуществления мобильных платежей. В рамках реализации Платежной директивы Евросоюза PSD2 банки будут обязаны использовать двухфакторную аутентификацию при осуществлении всех операций, в том числе базовых, таких как авторизация в учетной записи. Биометрическая аутентификация будет считаться лишь одним этапом двухфакторной аутентицикации, а в качестве второго должен использоваться пароль, токен или отдельное устройство.

Литература

- M. Sharif, S. Bhagavatula, L. Bauer, M. K. Reiter: Accessorize to a Crime: Real and Stealthy Attacks on State-of-the-Art Face Recognition. ACM Conference on Computer and Communications Security 2016: 1528-1540.

- Akhtar Z., Luca Foresti G.7. Face Spoof Attack Recognition Using Discriminative Image Patches, Department of Mathematics and Computer Science, University of Udine, Via delle Scienze 206, 33100 Udine, Italy Journal of Electrical and Computer Engineering, Vol. 2016, Article ID 4721849. 14 pp.

- Ian J. Goodfellow Ian J., Jonathon Shlens and Christian Szegedy Explaining and Harnessing Adversarial Examples // arXiv preprint arXiv:1412.6572v3, March 2015.

- Evtimov I., Eykholt K., Fernandes E., Kohno T., Li B., Prakash A., Rahmati A. And Song D. Robust physical-world attacks on deep learning models // arXiv preprint arXiv:1707.08945, 2017.

- Zhou Z., Tang D., Wang X., Han W., Liu X., Zhang K. Invisible Mask: Practical Attacks on Face Recognition with Infrared // arXiv preprint arXiv:1803.04683, March 2018.

- Turk M., Pentland A. Eigenfaces for Recognition Vision and Modeling Group The Media Laboratory Massachusetts Institute of Technology. Journal of Cognitive Neuroscience. Vol. 3, issue 1, winter 1991. P. 71–86.

- R. Jafri, H. R. Arabnia, A Survey of Face Recognition Techniques Journal of Information Processing Systems. Vol. 5, N 2, June 2009. P.41–67.

- Маршалко Г.Б., Никифорова Л.О., "Спуфинг-атака на биометрическую систему идентификации, использующую алгоритм распознавания Eigenfaces". 27-я Научно-техническая конференция "Методы и технические средства обеспечения безопасности информации".

- Ahonen T., Hadid A., Pietika¨inen M. Face Description with Local Binary Patterns: Application to Face Recognition // IEEE Trans. Pattern Analysis and Machine Intelligence, 1996. – N 28(12). – P. 2037–2041.

- Круглова C.И., Маршалко Г.Б7. "Исследование возможности обхода систем идентификации по лицам, использующих алгоритм LBP". 27-я Научно-техническая конференция "Методы и технические средства обеспечения безопасности информации".